原标题:如何防止人工智能技术被“恶用”?

清华大学人工智能国际治理研究院副院长、人工智能治理研究中心主任梁正。 受访者供图

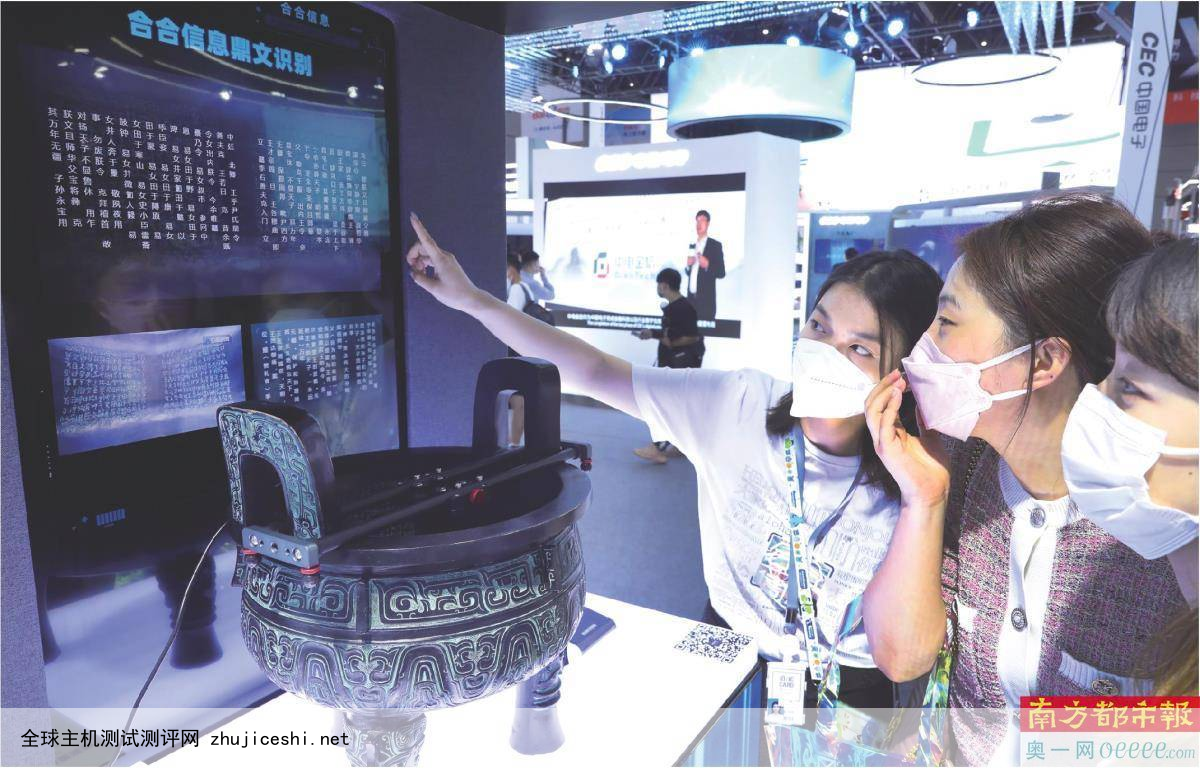

2022世界人工智能大会上,工作人员向参观者介绍一款智能文字识别AI系统对青铜鼎铭文的识别展示。 新华社发(资料图)

数字化3.0时代,人类生活越来越离不开人工智能。如何防止人工智能技术被“恶用”?越来越多的虚拟人是否会取代部分真人职业?如何克服算法歧视,让人工智能实现可知、可信、可控、可用?围绕上述热点问题,日前,清华大学人工智能国际治理研究院副院长、人工智能治理研究中心主任梁正接受了记者专访,进行解读。

现状 深度合成技术存在被“恶用”

AI换脸、AI换声、三维重建、智能对话……深度合成技术应用日益广泛,催生了美颜美妆、影视制作、智能客服、虚拟主播、元宇宙等应用服务,但也存在着被恶意利用的现象,一些不法人员用来制作、复制、发布、传播违法和不良信息,诋毁、贬损他人名誉、荣誉,仿冒他人身份实施诈骗等。

怎样抵御这些可能的“恶用”?梁正表示,对于深度合成,AI换脸是一个典型的应用。最近三部门出台了《互联网信息服务深度合成管理规定》,对于规范深度合成服务提出了明确要求。

根据规定,提供人脸、人声等生物识别信息显著编辑功能的,应当提示使用者依法告知被编辑的个人,并取得其单独同意。提供智能对话、合成人声、人脸生成、沉浸式拟真场景等具有生成或者显著改变信息内容功能服务的,应当在生成或者编辑的信息内容的合理位置、区域进行显著标识,向公众提示信息内容的合成情况,避免公众混淆或者误认。

梁正指出,使用个人肖像如果没有征得同意,就去公共互联网上采集使用的话,这属于违法行为。平台上如果有类似应用,平台就有责任去监督。即使是合法的使用,也要打上标签,让大家知道这不是真的,一定程度上可以减少深度合成内容产生的认知偏差和社会误导。如果平台自己去提供这一类服务,还要求用相应的工具去识别它不是真实的,这就对平台提出了更高的要求。

“不仅要合法合规,而且还要合意。”梁正表示,要进一步完善法律法规,严格落实相关规定,建立健全惩罚制度,个人要有维权意识,通过救济渠道维护自身合法权益,从而减少AI被恶意利用的现象。

趋势 虚拟人已经开始取代部分真人职业

近年来,虚拟代言人、虚拟主播、虚拟演员歌手,越来越多虚拟人在被推向市场。人们担心,虚拟人在未来或将取代部分真人职业。

“在娱乐、新闻领域,虚拟人的应用越来越多,因为它是一个低成本、高效率的方式。”在梁正看来,虚拟人越来越多也是一种必然的趋势,而且已经在替代部分真人职业了。比如,现在很多虚拟新闻主播,还有电话客服越来越多使用智能语音服务。“这个替代它一定是会部分发生的。”

新生事物发展背后也存在一些隐患。梁正提醒,大家不要把真假弄混了,虚拟人的形象、内容、对话都是基于训练的结果,或者是事先编好的,如果把它当成真人的话,就会产生误导。

“比如说,跟对话机器人去对话要非常小心。对于有些敏感话题,因为它背后没有意识,是顺着你说的,如果没有干预就可能产生误导,但它没有办法承担责任。所以要对虚拟形象的深度合成打上标签,并限定它的使用场景。特别是在教育医疗这样一些敏感的高风险场景,人工干预是必须的。”梁正说。

梁正认为,虚拟人的应用总体要分场景,在游戏、天气预报、新闻播报等一些低风险场景问题不大,但如果是高风险场景,就要非常小心,虚拟形象能够做什么,什么不能做,要把界限划清楚,比如心理陪伴机器人,要评估它说的话带来的长期心理影响是什么样的。

管理 下一代人工智能应该是可解释的

人工智能不能离开算法,算法公平和算法歧视话题也备受关注。国外一些研究和媒体报道提到,算法开发者或算法本身根据大数据积累存在种族、性别、文化等歧视的可能性。

对此,梁正表示,算法是依据数据训练出来的,数据有偏性是导致算法本身有偏性的一个主要原因。所以,算法歧视不是算法造成的,是社会本身造成的,是算法本身的技术特点所导致的,使用大量已经带有倾向性的数据,算法也就会作出一种倾向性的判断。

梁正指出,要想改变这种偏见,首先要纠正社会偏见。所以在使用数据的时候,要进行人工干预,在统计学上可以通过一些模拟数据来做一个平衡,但根本上是要赋予人工智能以常识,要把一些因果的因素考虑进去,而不是单纯只依赖于这种数据。

“绝对的算法公平并不存在。”梁正认为,算法公平具有多维性,常常面临“不可能三角”式的挑战。在公共管理领域中,起点公平、过程公平、结果公平三者同时实现基本是不可能的。绝对的公平实际上在算法的设计中其实也是做不到的,关键取决于你要什么样的目标。

梁正表示,要实现人工智能可知、可信、可控、可用。可知也就是可解释,这是最基础也是最复杂的层面,下一代人工智能应该是可解释的,如果说它不能够被解释的话,就会限制它很多方面的应用和大家对它的信任。算法可解释,这种条件下才能够放心去使用它。

“现在最大的问题就是黑箱,现有的人工智能是基于数据训练出来,你不知道中间发生的事,而新一代的人工智能就是要在数据的基础上加上知识,甚至要加上我们的逻辑,让它能够按照我们可理解的方式运行。”梁正说。

声音

要实现人工智能可知、可信、可控、可用。可知也就是可解释,这是最基础也是最复杂的层面,下一代人工智能应该是可解释的,如果说它不能够被解释的话,就会限制它很多方面的应用和大家对它的信任。算法可解释,这种条件下才能够放心去使用它。

——清华大学人工智能国际治理研究院副院长、人工智能治理研究中心主任梁正

中新网返回搜狐,查看更多

责任编辑:

0 留言